Lo siguiente es una serie de intercambios entre los miembros del equipo de Business Physics AI Lab: Thomas Hormaza Dow, Vinay Kumar, Hichem Benzair, Aboubakar Samake, Ann Lockquell así como nuestro Agentes de IA, Charlie y Lena.

Cómo el Laboratorio de Física Empresarial de IA preserva el juicio en el desarrollo de software humano-IA

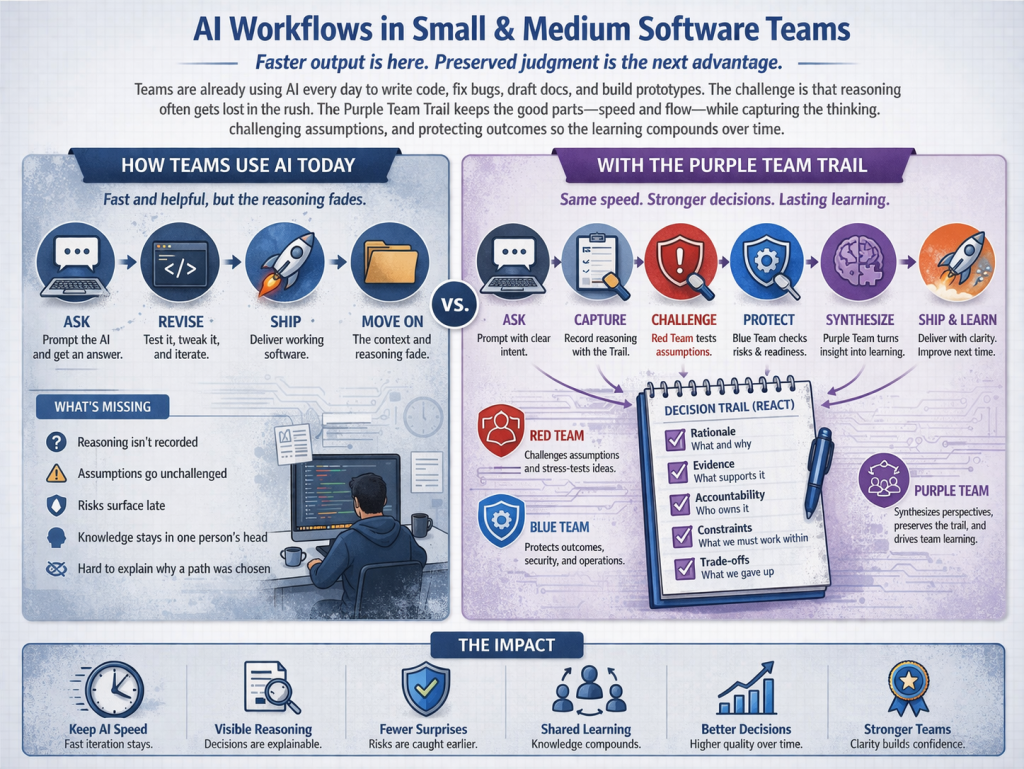

Muchos equipos ahora usan IA para generar código, sugerir correcciones, refactorizar funciones, redactar documentación y acelerar la entrega. Las ganancias de productividad son reales. Pero también lo es el riesgo. Cuanto más rápida es la interacción entre humanos e IA, más fácil es que desaparezca el razonamiento detrás del trabajo. Se prueba una indicación. Se acepta una sugerencia. Una función evoluciona. Se envía el código. Sin embargo, la lógica detrás de las decisiones puede desvanecerse casi tan rápido como avanza el trabajo.

Para nosotros, eso no es solo un problema de documentación, es una práctica profesional en cómo llevamos a cabo simulaciones de IA en nuestro laboratorio.

En el Laboratorio de IA de Física de Negocios, nuestra preocupación no es solo si el código funciona, sino si el juicio detrás del código permanece lo suficientemente visible para revisarlo, compararlo y mejorarlo. Queremos saber por qué se eligió un camino, qué evidencia lo hizo confiable, qué anuló el ingeniero, qué restricciones moldearon la decisión, qué concesiones se aceptaron y qué aprendió el equipo del proceso.

Por eso proponemos el trabajo en equipo con lo que llamamos el Sendero del Equipo Morado.

El Purple Team Trail es nuestra forma de preservar el rastro de decisiones en el desarrollo de software humano-IA. Proporciona estructura al trabajo de ritmo rápido para que las contribuciones humanas y de IA sigan siendo visibles con el tiempo. Nos ayuda a capturar el razonamiento mientras aún está fresco, comparar perspectivas a lo largo del ciclo de vida del trabajo y convertir la entrega en aprendizaje en lugar de dejar que desaparezca en un artefacto terminado.

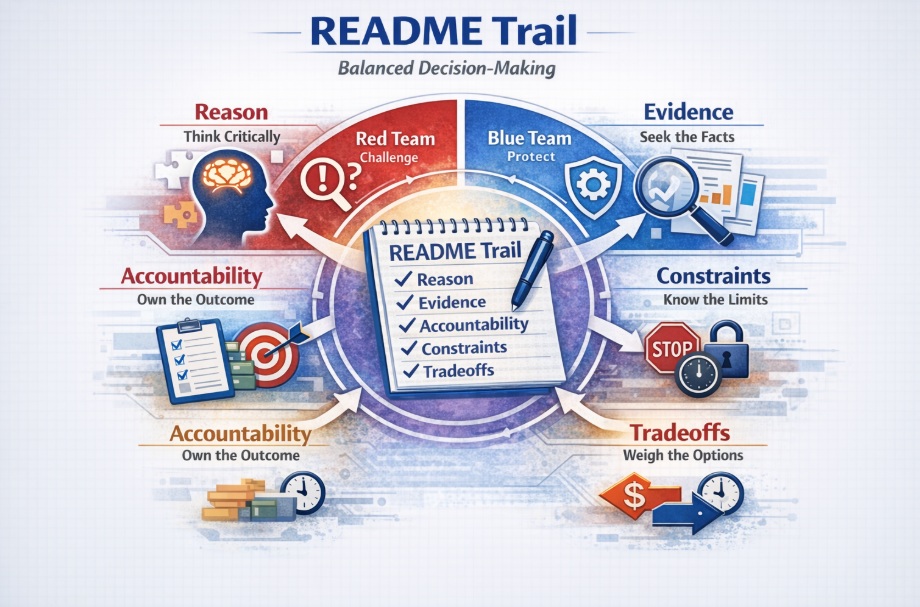

A nivel práctico, la Equipo Rojo busca debilidades. Desafía las suposiciones, pone a prueba si la confianza está justificada y pregunta dónde podrían fallar las cosas. El Equipo Azul se centra en la protección y la estabilidad. Se analiza qué debe funcionar de manera confiable, qué necesita salvaguardas y qué debe estar preparado para que el equipo soporte en uso real. Equipo Púrpura conecta ambos lados. Ayuda a comparar lo que se desafió, lo que se protegió y lo que se aprendió. En nuestro laboratorio, ese rol va más allá: el equipo púrpura ayuda a preservar el rastro de juicios para que la complementariedad humano-IA sea visible, revisable y útil a lo largo del tiempo.

El Business Physics AI Lab utiliza agentes de IA como parte de su modelo operativo. Esto ayuda al laboratorio a escalar su trabajo a través de una combinación de contribuciones humanas y de IA. Aun así, los humanos permanecen en control en todo momento. Dentro de este modelo de complementariedad humano-IA, cada recurso produce un bloque README para preservar el rastro de decisiones, aclarar roles y hacer que las decisiones sean revisables. La supervisión humana se mantiene durante todo el proceso, y un humano permanece involucrado en todas las actividades.

¿Por qué construimos este enfoque?

El Laboratorio de Física de Negocios de IA existe para comprender y mejorar cómo los humanos y los sistemas inteligentes trabajan juntos. Eso significa que nos interesan no solo los resultados, sino las fuerzas detrás de esos resultados: motivación, fricción, retroalimentación, confianza, adaptación y calidad de las decisiones.

El desarrollo de software es uno de los lugares más claros donde esas fuerzas se manifiestan ahora.

La IA puede ayudar a un desarrollador a avanzar más rápido, explorar más opciones y reducir el esfuerzo repetitivo. Pero la velocidad por sí sola no es suficiente. De hecho, la velocidad puede crear un nuevo tipo de fricción: la fricción del razonamiento que desaparece. El código puede parecer pulido, pero el camino detrás de él puede no estar claro. Eso debilita el intercambio de conocimientos, dificulta la incorporación, limita las revisiones de código y reduce la capacidad de la organización para aprender de lo que construye.

En otras palabras, el código puede ser visible, mientras que el juicio profesional detrás de él se vuelve invisible.

Ese es el problema que queríamos solucionar.

Necesitábamos una forma de preservar el juicio sin crear un proceso engorroso. Necesitábamos una forma de hacer que la interacción humano-IA fuera lo suficientemente visible como para respaldar la reflexión, la comparación y la rendición de cuentas. Y necesitábamos algo que los equipos pequeños, los grupos de investigación y los entornos de trabajo ágiles pudieran usar realmente.

Es por eso que el Purple Team Trail se encuentra en el centro de cómo operamos.

“Lo que hace que el Purple Team Trail sea especialmente valioso es que ayuda a proteger la tríada CIA —confidencialidad, integridad y disponibilidad— al hacer que las decisiones importantes sean visibles, cuestionables y estructuradas a lo largo del flujo de trabajo, de modo que los problemas de seguridad puedan detectarse antes en lugar de descubrirse más tarde.” – Hichem Benzair

Cuántos equipos de software pequeños usan IA hoy en día

Muchos equipos pequeños y medianos de desarrollo de software ya están utilizando la IA de formas prácticas. Los ingenieros la usan para generar código, refactorizar funciones, redactar pruebas, resumir requisitos, producir documentación, acelerar prototipos y explorar opciones técnicas. En ese sentido, la IA ya forma parte del flujo de trabajo diario. El problema no es que los equipos no utilicen la IA. El problema es que este uso a menudo sigue siendo rápido, individual y solo ligeramente documentado. La salida se guarda, pero el razonamiento detrás de ella a menudo no. Esa es la brecha que Purple Team Trail está diseñado para cerrar.

¿Por qué importa el Equipo Púrpura?

En muchas organizaciones, el Equipo Púrpura se describe como un puente entre el pensamiento del Equipo Rojo y el del Equipo Azul. En nuestro laboratorio, esa idea es útil, pero incompleta.

Para nosotros, el Equipo Púrpura es el custodio del rastro de auditoría.

Eso es lo que lo vuelve central.

El equipo rojo ayuda a exponer suposiciones débiles, confianza infundada y áreas donde la producción puede parecer más sólida que el razonamiento detrás de ella. El equipo azul ayuda a proteger lo que debe prevalecer en la operación real: estabilidad, salvaguardias, rendición de cuentas y resiliencia práctica. El equipo púrpura recibe esas perspectivas, las compara y las convierte en una forma de aprendizaje estructurado.

Esto importa porque el desarrollo humano–IA no solo produce código. Produce decisiones. Y las decisiones son donde la práctica profesional madura o se debilita.

Cuando el Equipo Morado preserva el rastro de esas decisiones, el laboratorio puede hacer más que entregar un resultado. Puede ver cómo surgió ese resultado, dónde el juicio humano resultó decisivo, dónde la IA realmente ayudó y qué debe cambiar la próxima vez.

Por eso, para nosotros, el Purple Team Trail no es un proceso secundario. Es parte de cómo protegemos la integridad de nuestro trabajo.

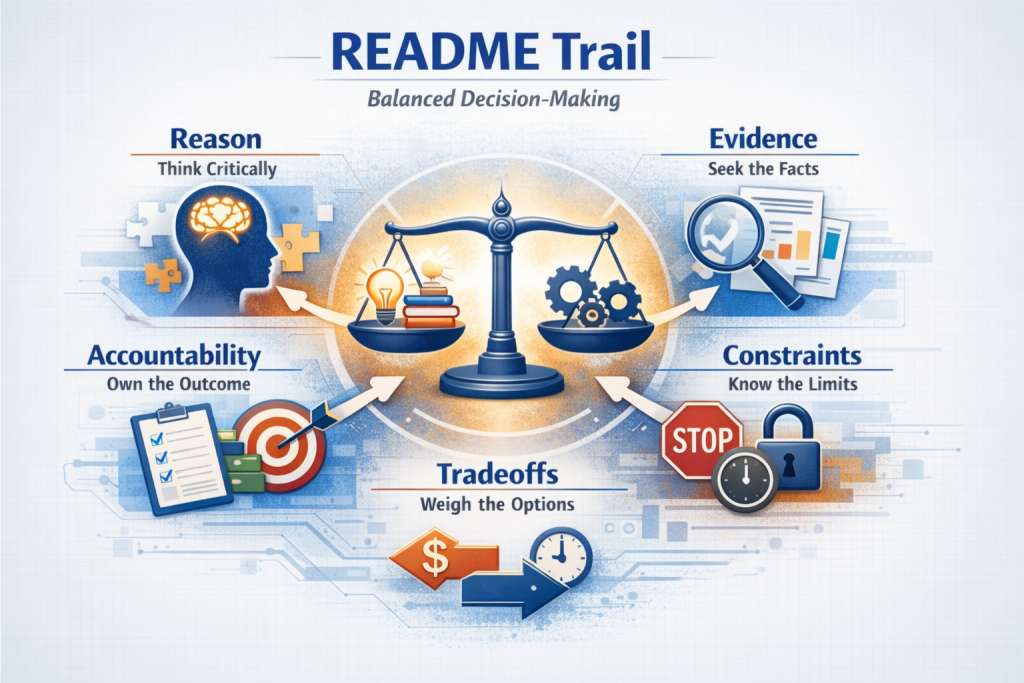

El framework REACT da forma a la ruta.

Para que el "Purple Team Trail" fuera útil, necesitábamos un marco de trabajo disciplinado pero liviano. Ahí es donde REACT se volvió esencial.

En el Laboratorio de IA de Física de Negocios, REACT nos ayuda a preservar el nivel de razonamiento que más importa:

Razón por qué se usó IA para una tarea en primer lugar.

Evidencia ¿qué verificaciones, pruebas o validaciones hicieron que el resultado fuera confiable?.

Rendición de cuentas ¿Quién aprobó el resultado final y quién es el dueño de la decisión?.

Restricciones ¿Qué reglas, límites o restricciones prácticas dieron forma al trabajo?.

Compensaciones ¿Qué fue optimizado y qué costos se aceptaron a sabiendas?.

Esta estructura es importante porque evita que el desarrollo asistido por IA se convierta en una mezcla confusa de decisiones rápidas sin una lógica clara detrás.

REACT no nos exige documentar cada pulsación de tecla o cada variación de indicación. Nos pide algo más útil: preservar el razonamiento que explica por qué el trabajo debe ser confiable.

¿Por qué este camino?

¿Por qué confiar en él?

¿Quién lo posee?

¿Qué lo formó?

¿Cuánto costó?

Esas preguntas son fundamentales para cómo trabajamos.

La reflexión no es papeleo extra

En el Laboratorio de IA de Física de Negocios, tratamos el Diario de reflexión sobre la práctica profesional como parte del trabajo en sí, no como un ejercicio académico añadido después.

Su papel es simple: hacer que el proceso de pensamiento detrás del trabajo sea lo suficientemente visible como para entenderlo, compararlo y mejorarlo.

Esto ayuda a los colaboradores individuales a reflexionar sobre cómo utilizaron la IA, dónde ejercieron su juicio y qué cambiarían la próxima vez. Ayuda al laboratorio a preservar la memoria compartida entre proyectos. Y nos ayuda a mantener la responsabilidad en situaciones donde la IA puede hacer que la división del trabajo entre humanos y máquinas se sienta difusa.

El diario de reflexión es importante porque convierte la resolución de problemas invisible en una práctica profesional visible.

Esto encaja de forma natural con nuestro trabajo más amplio en Física de Negocios. Nos interesa cómo aprenden los sistemas, dónde aparece la fricción, cómo se construye la confianza y cómo los bucles de retroalimentación mejoran el rendimiento con el tiempo. Un diario de reflexión es una de las formas más sencillas de hacer visibles esas dinámicas en el trabajo de software.

“El buen diseño no es solo sobre lo que la gente ve al final. También se trata del razonamiento que da forma a lo que se construye. La IA puede acelerar el resultado, pero los equipos aún necesitan una forma de preservar el criterio detrás del trabajo”. – Ann Lockquell

El bloque README es donde esto se vuelve operativo

También sabíamos que si este enfoque iba a funcionar, tenía que estar cerca del proceso de entrega. Es por eso que usamos un compacto Bloque README como la forma operativa del rastro de auditoría.

Se puede adjuntar a una solicitud de extracción, una rama de funcionalidad, un artefacto de sprint o un paquete de entrega final. Mantiene el razonamiento cerca del código, en lugar de empujarlo a un documento desconectado.

Un bloque típico puede incluir:

- Propósito

- Entradas (fuentes, enlace de prompt/config)

- Comprobaciones realizadas

- Humanos ↔ Roles de IA (traspaso, anula)

- Compromisos elegidos

- Valor humano agregado

- Aprendizaje y próximos pasos

Este bloque es intencionalmente pequeño. No está destinado a ralentizar el trabajo. Está destinado a preservar lo que de otra manera desaparecería.

Con el tiempo, hace algo aún más valioso: le da al laboratorio una forma de comparar patrones entre tareas. Podemos ver dónde la IA realmente ayudó, dónde creó una falsa confianza, dónde el juicio humano corrigió el rumbo y qué tipo de compensaciones aparecen repetidamente.

Entonces el bloque README no es solo una nota. Es parte de la infraestructura de aprendizaje del laboratorio.

Uso formativo y sumativo

El Purple Team Trail funciona mejor cuando se utiliza durante todo el ciclo de vida del trabajo, no solo al final.

Por eso pensamos en ambos formativo y sumativo términos.

Durante el desarrollo, las notas cortas y formativas en los archivos README ayudan a capturar el razonamiento mientras el trabajo aún está en curso. Registran lo que se intentó, cómo se usó la IA, qué pruebas se ejecutaron, qué cambios se hicieron y qué inquietudes quedan. Estas notas son útiles precisamente porque están cerca del momento de la decisión.

Al final de una tarea o funcionalidad, un README sumario une el proceso. Explica la dirección final, las principales compensaciones, el papel de la IA, qué se desafió, qué se protegió y qué el equipo debe continuar.

El Equipo Morado es central aquí. Reúne las aportaciones formativas, compara las perspectivas del Equipo Rojo y el Equipo Azul, y sintetiza el rastro de juicio final en un registro de cierre utilizable.

Un ejemplo sencillo aclara el proceso. Un equipo de laboratorio utiliza IA para acelerar el desarrollo de una función. Durante el trabajo, el Equipo Rojo señala que una suposición no se ha probado lo suficiente en condiciones extremas. El Equipo Azul indica que la función puede ser estable en el uso normal, pero aún carece de suficiente monitoreo para soporte en el mundo real. El Equipo Morado conserva ambas perspectivas en el rastro del README en evolución, y luego las sintetiza al final: lo que aportó la IA, lo que decidieron los humanos, lo que se cuestionó, lo que se protegió y lo que el equipo debería hacer de manera diferente la próxima vez. El resultado final no es solo código entregado. Es código entregado con razonamiento conservado.

Ese es exactamente el tipo de ciclo de aprendizaje que queremos.

“El verdadero riesgo en el desarrollo asistido por IA a menudo no es el modelo. Es la ausencia de requisitos claros, una descomposición de tareas sólida y una intención arquitectónica temprana. La IA puede generar resultados prometedores rápidamente, pero el juicio humano sigue siendo lo que crea claridad, estructura el trabajo y mantiene al equipo en control.” – Vinay Kumar

El Equipo Púrpura Fortalece el Flujo de Trabajo

| Cuántos equipos de software pequeños usan IA hoy en día | Cómo el Purple Team Trail fortalece ese flujo de trabajo |

| La IA se usa a menudo informalmente dentro del flujo de trabajo diario. | La IA sigue siendo parte del flujo de trabajo diario, pero su uso se vuelve más visible y estructurado. |

| Los ingenieros proponen, prueban, revisan y lanzan rápidamente. | Los ingenieros aún proponen, prueban, revisan y envían, pero también conservan el razonamiento detrás de las decisiones clave. |

| Se aceleran la generación de código, la refactorización, la depuración, la documentación y la creación de prototipos. | Esas mismas actividades se aceleran, pero el juicio detrás de ellas es capturado y revisado. |

| La salida usualmente se guarda. El razonamiento detrás de ella, a menudo no. | El resultado se guarda y el razonamiento se preserva a través de README Trail y la estructura REACT. |

| El uso de la IA a menudo se mantiene a nivel individual. | El uso de IA se vuelve más fácil de compartir, revisar y aprender en todo el equipo. |

| Los prompts y las salidas del modelo pueden influir en las decisiones sin dejar un rastro claro. | Las decisiones importantes se documentan a través de Razón, Evidencia, Rendición de cuentas, Restricciones y Compensaciones. |

| Las revisiones de código a menudo se centran principalmente en el artefacto final. | Las revisiones pueden considerar tanto el artefacto como el rastro de juicio detrás de él. |

| Los equipos pueden avanzar rápidamente pero tener dificultades para explicar después por qué se eligió un camino. | Los equipos se mueven rápidamente mientras mantienen un registro útil de por qué se tomaron las decisiones. |

| Las suposiciones débiles o los riesgos ocultos pueden salir a la luz tardíamente. | El pensamiento de equipo rojo ayuda a desafiar las suposiciones más temprano. |

| Las preocupaciones operativas pueden permanecer implícitas hasta que aumente la presión de implementación. | El pensamiento del Equipo Azul ayuda a hacer más explícitas la protección, la estabilidad y la preparación operativa. |

| El aprendizaje a menudo queda atrapado en la memoria de un ingeniero o en notas dispersas. | El pensamiento de equipo púrpura ayuda a comparar perspectivas, preservar el aprendizaje y sintetizar lo que el equipo debe continuar. |

| La IA puede escalar la producción, pero la comprensión puede seguir siendo desigual. | La IA aún escala la producción, pero el flujo de trabajo está diseñado para fortalecer la comprensión compartida y la responsabilidad. |

| Los equipos más pequeños pueden sentir que carecen de los recursos para procesos de aprendizaje formales. | Los equipos más pequeños obtienen una forma ligera de capturar aprendizajes sin necesidad de una gran estructura empresarial. |

| La documentación puede sentirse separada de la entrega. | El README Trail se convierte en parte de la entrega en sí. |

| “Hecho” a menudo significa que el código funciona. | “Hecho” significa que el código funciona y el razonamiento detrás de este es lo suficientemente visible para ser revisado, comparado y aprendido. |

¿Por qué esto mejora nuestra práctica profesional?

Este enfoque fortalece nuestra forma de trabajar de varias maneras.

Mejora compartir conocimientos porque el razonamiento ya no desaparece en la memoria de una sola persona.

Mejora colaboración porque la gente puede ver no solo lo que se construyó, sino cómo se tomaron decisiones importantes.

Mejora rendición de cuentas porque se hace visible tanto el rol humano como el rol de la IA.

Mejora consistencia porque el laboratorio desarrolla una estructura compartida para explicar el trabajo asistido por IA.

Mejora aprendizaje para que se puedan comparar diferentes enfoques en lugar de tratarlos como cajas negras.

Y mejora madurez profesional porque la entrega incluye un juicio visible, no solo el resultado final.

Lo más importante es que nos ayuda a practicar la complementariedad humano-IA de manera disciplinada. No queremos que el uso de la IA en el laboratorio siga siendo informal, invisible o particular. Queremos que se convierta en una forma de trabajar visible y mejorable.

“La pregunta a la que siempre vuelvo no es si el resultado es bueno. Es si todavía puedo explicar por qué tomé la decisión. El Purple Team Trail lo hace visible.” – Aboubakar Samake

Norma sólida para el trabajo humano-IA

En el Business Physics AI Lab, el cambio de rumbo del Equipo Morado redefine lo que significa “hecho”.

Hecho ya no significa solo que el código funciona.

Hecho significa que el código funciona y la lógica detrás de esto es lo suficientemente visible como para revisarla, compararla y aprender de ella.

Ese es un estándar más estricto, y está en línea con cómo pensamos sobre la calidad del sistema en general. En términos de Física de Negocios, un mejor rendimiento no proviene solo de un movimiento más rápido. Proviene de una mejor retroalimentación, menor fricción oculta, mayor confianza confiable y una mejor alineación entre personas, herramientas y decisiones.

El Purple Team Trail apoya exactamente eso.

A medida que la IA se integre más en el desarrollo de software, los equipos que maduren más rápido no serán simplemente los que generen código más rápido. Serán aquellos que conserven el juicio mientras se mueven rápidamente.

Ese es el estándar que estamos intentando construir.

“Los equipos que madurarán más rápido en el desarrollo asistido por IA no son simplemente los que generan código más rápido. Son los que conservan el juicio mientras se mueven rápidamente y hacen que ese razonamiento sea lo suficientemente visible como para mejorar con el tiempo.” – Thomas Hormaza Dow

Conclusión

En el Laboratorio de IA de Business Physics, vemos el desarrollo de software humano-IA como una cuestión de práctica profesional, no solo de resultados técnicos.

Es por eso que el Purple Team Trail es importante para nosotros. Con el Equipo Púrpura en el centro, el Framework REACT proporcionando estructura, la Diario de reflexión preservando el razonamiento, y el Bloque README incrustándolo en la entrega, tenemos una forma práctica de mantener el rastro de la sentencia visible durante todo el trabajo.

El Equipo Rojo desafía las suposiciones.

El Equipo Azul protege los resultados.

El Equipo Morado preserva el rastro del juicio.

Ese camino es lo que nos permite hacer más que enviar código. Nos permite fortalecer el aprendizaje, la rendición de cuentas y la complementariedad humano-IA al mismo tiempo.

Deja un comentario